Künstliche Intelligenz hat schon seit Jahren in zahlreichen Anwendungen Einzug in verschiedene Lebensbereiche erfahren, doch nun hat ChatGPT einen wahren Hype ausgelöst – nicht zuletzt aufgrund der starken medialen Resonanz in den letzten Wochen. Und selbstverständlich fragen auch ausgewiesene Nicht-Experten sofort nach möglichen Einsatzgebieten dieser KI – wie z. B. in der Medizin.

Dieser speziellen Frage werden wir uns in nachfolgenden Beiträgen widmen – das Thema KI wird uns also noch eine Weile begleiten. Jetzt wollen wir an einem einfachen Beispiel zeigen, welche Resultate diese KI heute liefern kann.

Vor einigen Wochen erschien hier in unserem Blog ein Beitrag zu einer Rede des Bundesgesundheitsministers. Nun haben wir ChatGPT die Aufgabe gestellt den ursprünglichen Text in zwei Sätzen zusammenzufassen. Hier das erste Ergebnis:

Bundesgesundheitsminister Karl Lauterbach sprach bei der Digital Health Conference über seine Pläne für die Telematikinfrastruktur und kündigte ein großes Digitalisierungsgesetz für die erste Hälfte 2023 an. Lauterbach setzt auf eine Cloud- und Smartphone-basierte Informationslandschaft und bevorzugt die Opt-out-Variante bei der elektronischen Patientenakte, da sie sonst nicht in der Fläche ankommen würde.

Die Bearbeitungszeit betrug übrigens weniger als 10 Sekunden.

Abschließend der Beitrag zum Vergleich in voller Länge:

DER TIGER UND DIE ZUKUNFT DER TELEMATIK

Bundesgesundheitsminister Karl Lauterbach gibt Gas. Vor zwei Wochen hatten wir seine Pläne für die onkologische Versorgung vorgestellt, die er auf dem Deutschen Krebskongress präsentiert hatte. Auf der Digital Health Conference des Branchenverbandes bitkom hat er letzte Woche jetzt ausführlich über seine Pläne für die Telematikinfrastruktur gesprochen.

Die Kernbotschaft: Den Konnektoren gehört die Vergangenheit und ein Stück weit noch die Gegenwart, die Zukunft aber einer Cloud- und Smartphone-basierten Informationslandschaft. „Die Infrastruktur ist oft veraltet, bevor sie genutzt wird“, stellte der Minister dabei treffend fest und kündigte ein großes Digitalisierungsgesetz für die erste Jahreshälfte 2023 an.

Den wichtigsten Punkt für die Umsetzung hatte er schon beim DKK herausgehoben: die Opt-out-Variante bei der elektronischen Patientenakte (ePA). Mit der einleuchtenden Begründung: „Sonst würde die ePA niemals in der Fläche ankommen“. Dass solche Rechnungen aufgehen, zeigt das Beispiel Finnland. Von rund 5 Millionen Bürgern, die krankenversichert sind, haben bei der Einführung der dortigen ePA weniger als 100 von der opt-out-Regelung Gebrauch gemacht.

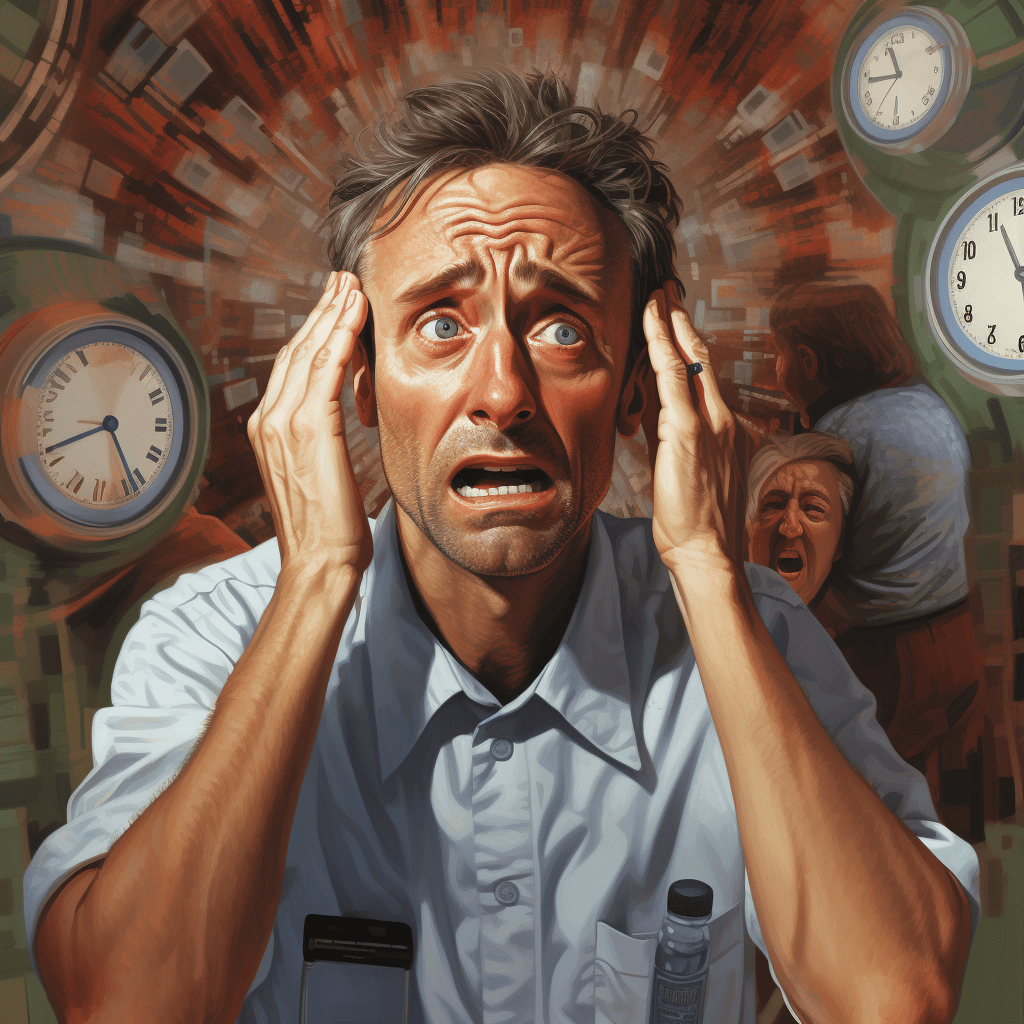

Und beim Zeitplan heißt es jetzt: Bitte anschnallen. Noch in dieser Legislaturperiode soll es soweit sein und die ePA dann für alle Versicherten automatisch eingerichtet werden, so der Minister. Das habe die Gesellschafterversammlung der gematik am letzten Montag entschieden. Vergleicht man das mit den Fortschritten der letzten 20 Jahre, ist außerordentlich ambitioniert für den Zeitplan sicher noch maßlos untertrieben.

Und man braucht kein Prophet sein um zu ahnen, dass dieses Projekt am Ende der Legislaturperiode maßgeblich für das „Arbeitszeugnis“ sein wird. Schafft Lauterbach das, wird er als DER Digitalisierer in die Ministeriumsgeschichte eingehen. Ansonsten wird das gleiche gelten, wie für seine Vorgänger: Als Tiger gestartet und als Bettvorleger geendet.